De nombreux acteurs ont fait part à la CNIL de questionnements concernant l’application du règlement général sur la protection des données (RGPD) à l’intelligence artificielle (IA), en particulier avec l’essor des systèmes d’IA génératives (Generative AI systems).

Pour la CNIL, le développement de ces systèmes est conciliable avec les enjeux de protection de la vie privée. Plus encore, la prise en compte de cet impératif permettra de faire émerger des dispositifs, outils et applications éthiques et fidèles aux valeurs européennes.

C’est à cette condition que les citoyens feront confiance à ces technologies. Pour cela, il est important que les acteurs disposent d’éléments clairs et pratiques d’analyse pour éclairer les décisions stratégiques de développement ou d’utilisation de l’IA que de nombreux organismes doivent prendre dans les prochains mois.

Une nouvelle série de recommandations soumises à consultation publique

Le 8 avril 2024, à la suite d’une consultation du secteur, la CNIL a publié ses premières recommandations sur le développement des systèmes d’IA. Elles répondent notamment aux interrogations portant sur l’application des principes de finalité, de minimisation et de durée de conservation pour le développement des systèmes d’IA. Elles clarifient également certaines règles applicables à la recherche scientifique, à la réutilisation de bases de données ou à la réalisation d’analyse d’impact sur la protection des données (AIPD).

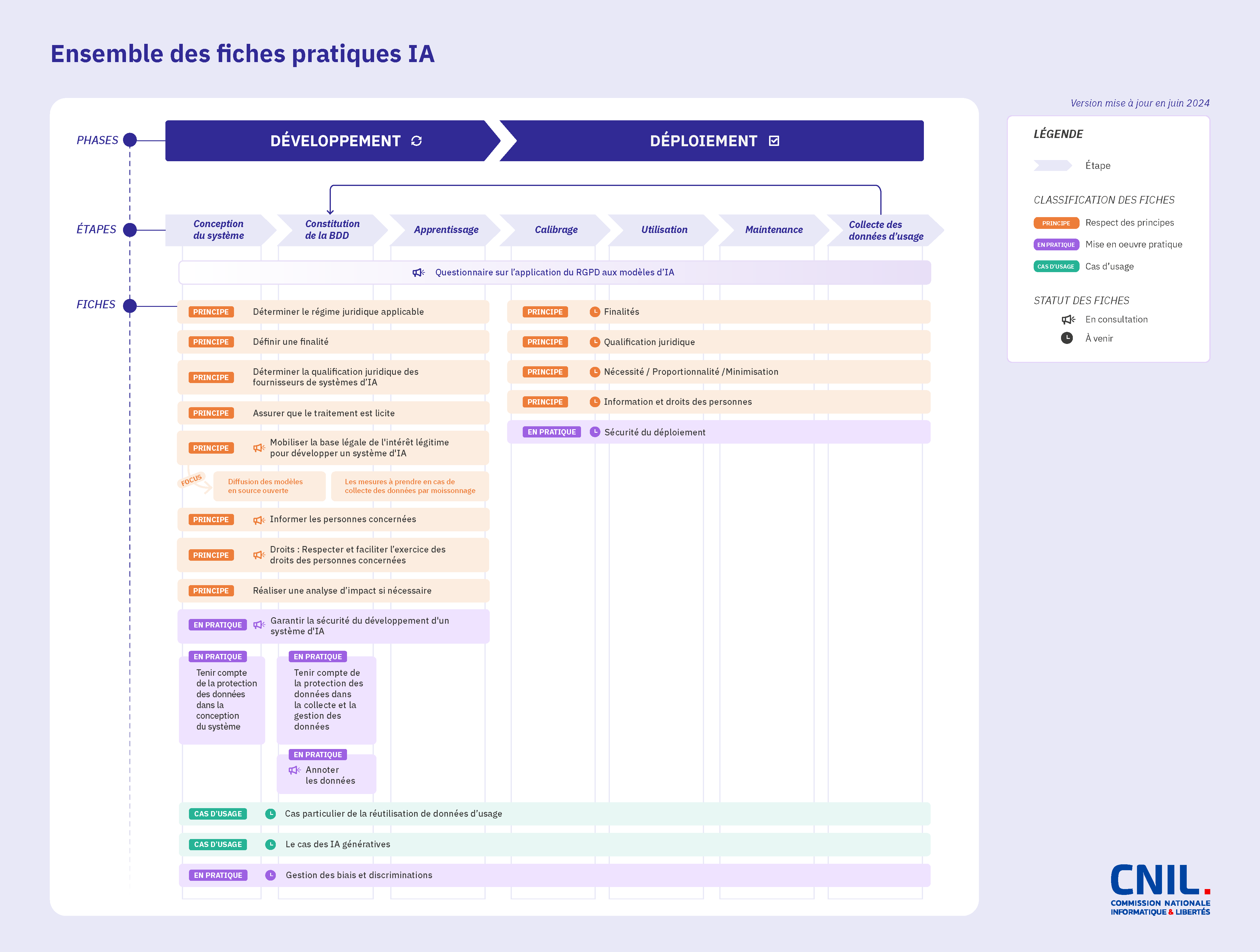

Dans la continuité de ces travaux et afin d’apporter des réponses complémentaires aux interrogations partagées par les professionnels, la CNIL ouvre une nouvelle consultation publique sur les 7 fiches suivantes :

- Base légale de l’intérêt légitime et développement de systèmes d’IA

- Intérêt légitime : focus sur la diffusion des modèles en source ouverte (open source)

- Intérêt légitime : focus sur le moissonnage (web scraping)

- Informer les personnes concernées

- Respecter et faciliter l’exercice des droits des personnes concernées

- Annoter les données

- Garantir la sécurité du développement d’un système d’IA

***

Recommandations pour les systèmes d'IA

Participer à la consultation

***

Un questionnaire sur l’application du RGPD aux modèles d’IA

Dans le cadre de cette consultation, la CNIL publie un questionnaire sur l’application du RGPD aux modèles d’IA.

Les modèles d’IA peuvent mémoriser une partie des données utilisées pour leur apprentissage. Différentes manipulations peuvent ensuite permettre de les extraire. Lorsque les données d’entraînement contiennent des données personnelles, les modèles d’IA pourraient entrer dans le champ d’application du RGPD, y compris lorsque les risques pour les personnes sont limités.

La CNIL invite les fournisseurs et utilisateurs de systèmes d’IA, ainsi que l’ensemble des acteurs concernés, à apporter leurs éclairages sur les conditions dans lesquelles les modèles d’IA peuvent être considérés comme anonymes ou doivent être encadrés par le RGPD et sur les conséquences d’une telle qualification.

Avec ce questionnaire, la CNIL sollicite ainsi toutes les parties prenantes du secteur pour adapter ses futures recommandations aux risques réels pour les personnes concernées et aux capacités du secteur à les réduire.

***

Application du RGPD aux modèles d'IA

Répondre au questionnaire

***

Quel a été le processus d’élaboration des fiches et du questionnaire ?

L’élaboration de ces fiches pratiques et du questionnaire s’est fait sur la base des échanges que la CNIL a organisé avec des acteurs publics et privés, y compris le monde de la recherche scientifique, pour recueillir leurs observations ou leurs interrogations sur les questions abordées.

Enfin, lors de la consultation publique concernant les première recommandations, la CNIL a reçu 43 contributions, émanant d’acteurs variés de l’écosystème de l’IA. Elles ont soulevé des points d’interrogation structurants qui ont permis d’alimenter ces nouvelles fiches.

Quel est le calendrier de la consultation et qui peut contribuer à la consultation ?

Cette consultation publique prendra fin le 1er septembre 2024.

La CNIL souhaite permettre au plus grand nombre, qu’il s’agisse de personnes physiques ou morales, publiques ou privées, de participer à cette consultation publique. Elle veut en particulier mobiliser l’ensemble des acteurs de l’IA (entreprises, chercheurs, universitaires, associations, conseils juridiques et techniques, etc.) autour des enjeux de protection des droits et libertés que son usage implique.

Comment participer à la consultation ?

Les contributions doivent se faire en répondant directement dans les formulaires « recommandations pour les systèmes d’IA » et/ou « application du RGPD aux modèles d’IA ».

Il n’est pas nécessaire de formuler des observations sur l’ensemble des fiches ou de répondre à toutes les questions du questionnaire pour répondre à la consultation publique. La CNIL conseille cependant de lire toutes les fiches qui vous intéressent ou vous concernent avant de répondre, de manière consolidée, au formulaire sur les recommandations pour les systèmes d’IA.

Les réponses à la consultation publique peuvent être collectives et se faire par le biais de fédérations, associations, etc.

Quelles sont les prochaines étapes ?

Les contributions seront analysées à l’issue de la consultation publique pour permettre la publication des recommandations définitives, sur le site web de la CNIL, courant 2024. Cette deuxième série de recommandations sera complétée par d’autres publications sur l’IA tout au long de l’année 2024.

Article publié sur le site : Intelligence artificielle : nouvelle consultation publique sur le développement des systèmes d’IA | CNIL

Dernière modification le mercredi, 12 juin 2024